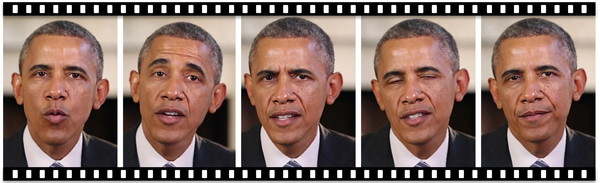

フェイクニュースだけではありません。これからはAIを使った「フェイク映像」が社会問題になるかも知れません。話している人の映像を改変して「違う言葉」を話す映像を作り出してしまう、非常に危険な人工知能の開発にワシントン大学の研究グループが成功しました。

事実とは異なる内容の記事を書けばフェイクニュースですが、テキストで書かれた内容にはそれが事実だと確信がもてる証拠がありません。そのため、読む側もはじめから一切の疑いをもたずに読むことはないでしょう。

また、最近は画像を加工技術が発達しているため「写真」を証拠だとして見せられても、テキストよりは信用度が高まりますが完全に信じるかといえば、そうでもないことも多いと思います。

しかし「映像」の場合はどうでしょうか。特定の人物が話をしている映像を見せられたら、それが「作られたもの」だと疑う人はなかなかいないのではないでしょうか。

ところが、どうやらこれからの時代は映像であっても100%信用することはできないのかも知れません。

研究グループは、話している人の映像を改変して唇の形を変えてしまい、別の用意された会話の音声にマッチさせる人工知能を開発しました。

開発に使用したのは米国のバラク・オバマ前大統領の映像と音声。約14時間にも及ぶ高画質の映像を使用してAIを学習させました。

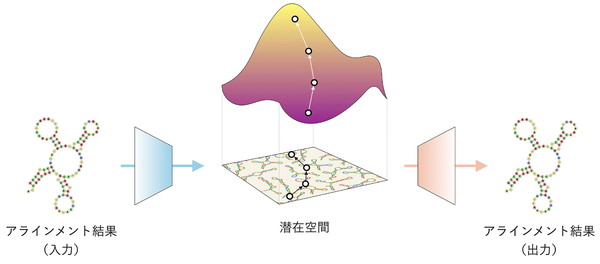

AIの学習にはリカレントニューラルネットワークを使用。リカレントニューラルネットワークはAIの学習に時間軸の情報を含めることができるため、動画の認識に利用することができます。

実際に、AIはオバマ前大統領が話している言葉を動画中での口の形状にマッチさせることが可能になり、さまざまな「サウンド」に合うような口の形状が3次元的に作成されました。

さまざまなサウンドに適合する口の形状が入手できたことから、これらの情報を使って他の映像の顔にマッピングできます。

つまり、オバマ前大統領が何かを話している映像が入手できれば、この映像を改変して全く別の話をしている映像を自然な形で新たに作り出すことができるわけです。

研究グループによると、今回開発したAIはSkypeなど「ビデオチャット」で使用して映像の画質を改善することに使えるとしています。

しかし、当然ながらこのAIが可能にするのは、ビデオチャットの画質改善だけにとどまるわけではありません。

これまでは内容が疑わしいニュースが流れたとしても、実際に映像があればそれだけを根拠に真実としてみなすことができました。しかし、もしこのような高精度な「フェイク映像」が可能だとすると、これからはフェイクニュースに対する考え方を変えていかなければならないかも知れません。

もちろん、この問題はニュースだけにとどまりません。誰かをだます目的で偽のアリバイ映像を作ることだって可能にしてしまいます。

しかしこのAIを開発したグループによると、このプログラムは実際の音声でしか機能しないとしています。そのため、たとえばオバマ前大統領の偽の映像は、彼自身が実際に話した肉声でしかつくることができません。

確かに、他者の音声を使っても偽映像を作ることができないのであれば、ある程度は制限が加えられます。全く身に覚えのない内容ではなく、「実際に口にしたことがある話」で映像が作られるわけですから。

しかし一方で、比較的短い音声のサンプルを学習して、数百もの異なるアクセントを複製できる人工知能を中国のBaiduが開発しているとの話もあります。

もしこのような技術が実用化されてしまえば、オバマ前大統領の「声」を新しく作ることも可能になるため、完全なフェイク映像を生み出すこともできてしまいます。

比較的近い将来、このような完全なフェイク映像を簡単に生み出すことができる時代がやってくる確率は、相当高いのではないでしょうか。