フェイスブックが自殺の可能性があるユーザーを救う取り組みを始めると発表しています。人工知能を活用して自殺をほのめかす投稿を抽出、投稿者に相談を促したり、家族や友人らに警告を出したりします。

新たなシステムでは、ユーザーが投稿するコンテンツをAIが分析して自殺の可能性を検出します。投稿者の友人らからの「are you OK?(大丈夫?)」「Do you need help?(何か私にできることはない?)」などのコメントも手がかりにします。

また、含まれるのはテキストによる投稿だけではなく、「Facebook Live」という動画形式の投稿も対象となります。

この検知システムは、当初は米国内のみで試験的に導入されていましたが、今後は日本を含む米国以外の国々の投稿も対象にしていくとのこと。(ただし、EU諸国はプライバシー関連の法律が複雑なために除外)

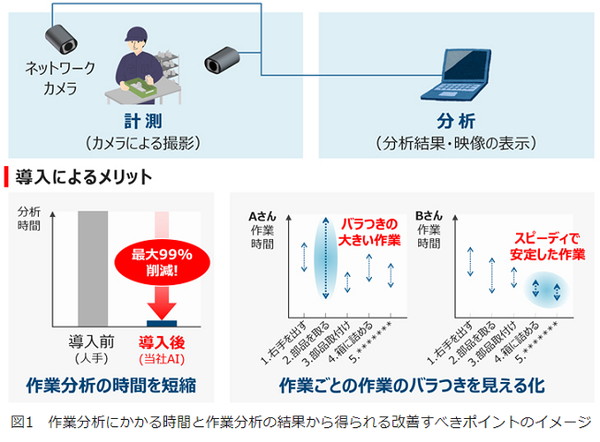

システムでは、AIが大量の投稿から自殺の可能性のあるユーザーを検知して、フェイスブック内に設置された専門チームに通知されます。その後、チームの担当者が精査して必要な対処をすることになります。

従来では、自殺の可能性がある投稿を読んだ人からの通報を待って行動していましたが、新しいシステムでははるかにスピーディーな対応が可能になるとのこと。

同社によると、米国では今年3月にこの機能を先行導入してから、先月だけで100件の対応につながったとしています。

また、特に深刻なケースを迅速に検知するために「パターン認識」も活用しており、ほかの報告と比べると2倍の速さで現地の当局に通報することができました。

フェイスブックのザッカーバーグCEOは以下のようにフェイスブックのページに投稿しています。

AIを使うことで自殺の予防に役立つ。AIが将来有害なものになるとの懸念があるが、AIが今現在、人の命を救うために役立っていることに気付くことはよいことだ。将来、AIは言語の微妙なニュアンスをもっと理解できるようになり、さまざまな種類のいじめや憎悪を素早く発見するなど、自殺以外のさまざまな問題を特定することもできるようになる。

自殺の可能性がある投稿がAIによって検知されるとフラグが立てられ、それに基づいて人間のモデレーターが適切な対処を行います。モデレーターは専門的な訓練をうけており、24時間体制で待機するとしています。

日本でも、神奈川県座間市にあるアパートで9人の遺体が発見された事件では、被害者らがSNSで自殺をほのめかす投稿などをしていました。

SNSの投稿は個人情報の流出や犯罪に巻き込まれる発端となるなどネガティブな面もありますが、周りの人たちが気付きにくい個人が抱えている悩みや問題などを知るきかけになるケースもあります。

フェイスブックが始めた今回の取り組みは、ほかのSNSでも取り入れられていく可能性は多いにあり、また大量の投稿内容を分析するために人工知能が多いに活用されていくものと考えられます。